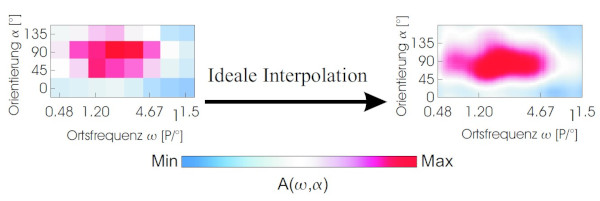

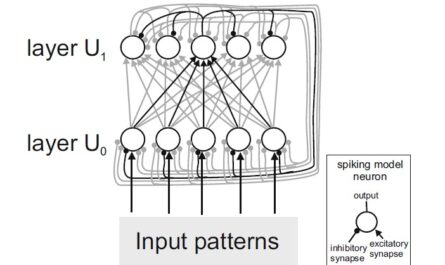

Dass die Nervenzellen im primären Sehkortex selektiv auf die Orientierung (den Winkel) von Helligkeitskanten reagieren, ist seit den Arbeiten von Hubel und Wiesel (1962) bekannt. Später fand man heraus, dass diese Nervenzellen auch auf Streifenmuster reagieren und ihre Antwort vom Abstand der Streifen und damit von der „Ortsfrequenz“ (dem Kehrwert der Periodenlänge) abhängt.

Vor 22 Jahren habe ich dazu in der Arbeitsgruppe von Prof. Reinhard Eckhorn am FB Physik der Philipps-Universität Marburg meine Diplomarbeit geschrieben. Darin habe ich unter anderem einen Schnelltest zur Bestimmung der Ortsfrequenz-Selektivität von elektrophysiologisch abgeleiteten Neuronengruppen entwickelt. Das Wissen über die Verarbeitung von Ortsfrequenzen im Sehsystem findet mittlerweile auch Anwendung in künstlichen neuronalen Netzen zur visuellen Objekterkennung.

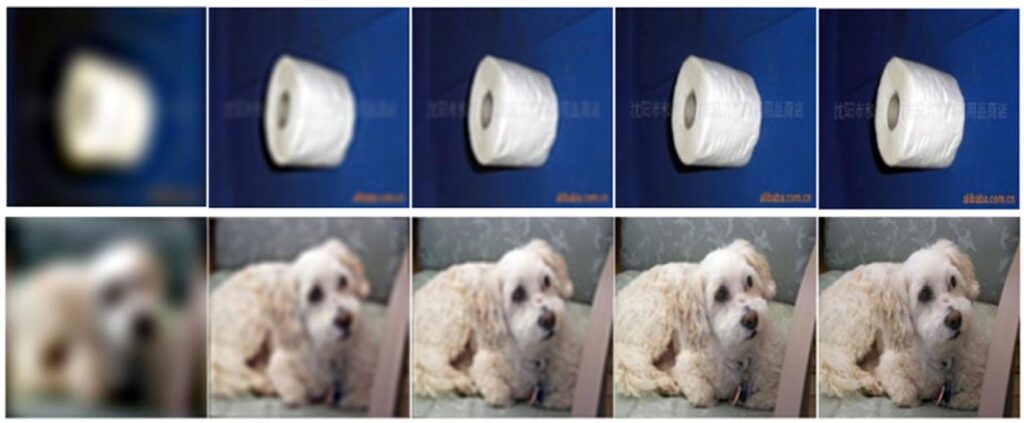

Ein interessantes Beispiel ist eine Arbeit von Lev Kiar Avberšek, Astrid Zeman und Hans Op de Beeck (2021): „Training for object recognition with increasing spatial frequency: A comparison of deep learning with human vision“. Diese haben ein „deep convolutional neural network“ (CNN) mit Bildern mit unterschiedlichen Ortsfrequenzanteilen trainiert. In einer ersten Lernphase verwendeten sie tiefpass-gefilterte Bilder, die daher nur niedrige Ortsfrequenzen enthielten und daher unscharf aussahen. Sie konnten zeigen, dass mit dieser Art des Trainings die Erkennungsrate für tiefpass-gefilterte Bilder aus dem ImageNet-Datensatz von 0 Prozent auf 32 Prozent steigt.